什么是AI超算网络?传统网工必须了解的新赛道来了!

网工要正式进入一个全新的领域了——

AIDC

围绕 AI 超算网络、智算中心 这个方向,持续输出内容。这不是追热点,而是因为——

网络工程师的下一个增长极,就在这里。

AI超算网络系列直播第一讲:《什么是 AI 超算网络?》

📍

📌

什么是 AI 超算网络?

你可能听说过“智算中心”、“GPU 集群”、“万卡训练”……但这些和网络有什么关系?

简单说:训练一个大模型,需要成千上万张 GPU 同时工作。这些 GPU 之间怎么连接、怎么通信,就是 AI 超算网络 要解决的问题。

我们来拆解一下。

一、为什么 AI 训练需要特殊的网络?

传统数据中心的网络,主要服务于“东西向流量”——服务器之间传数据,延迟高一点、偶尔丢个包,问题不大。

但 AI 训练完全不同:

- 规模大: 一次训练动辄用几千张 GPU,全部要协同计算

- 通信量巨大: 每一轮梯度同步(All-Reduce),所有 GPU 都要互相交换数据

- 延迟敏感: 网络慢一点点,整个训练集群都要等,GPU 白白空转

- 带宽要求极高: 单卡带宽需求轻松达到 400Gbps 甚至 800Gbps

专门为 AI 设计的网络架构就自然而然出来了

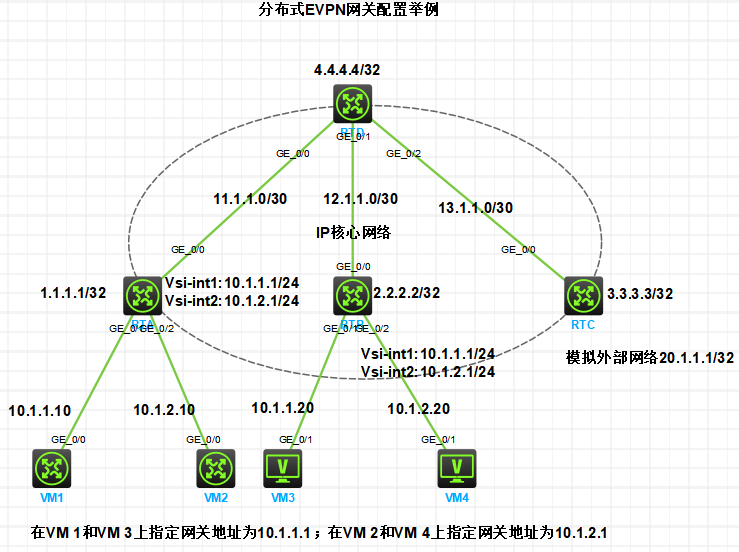

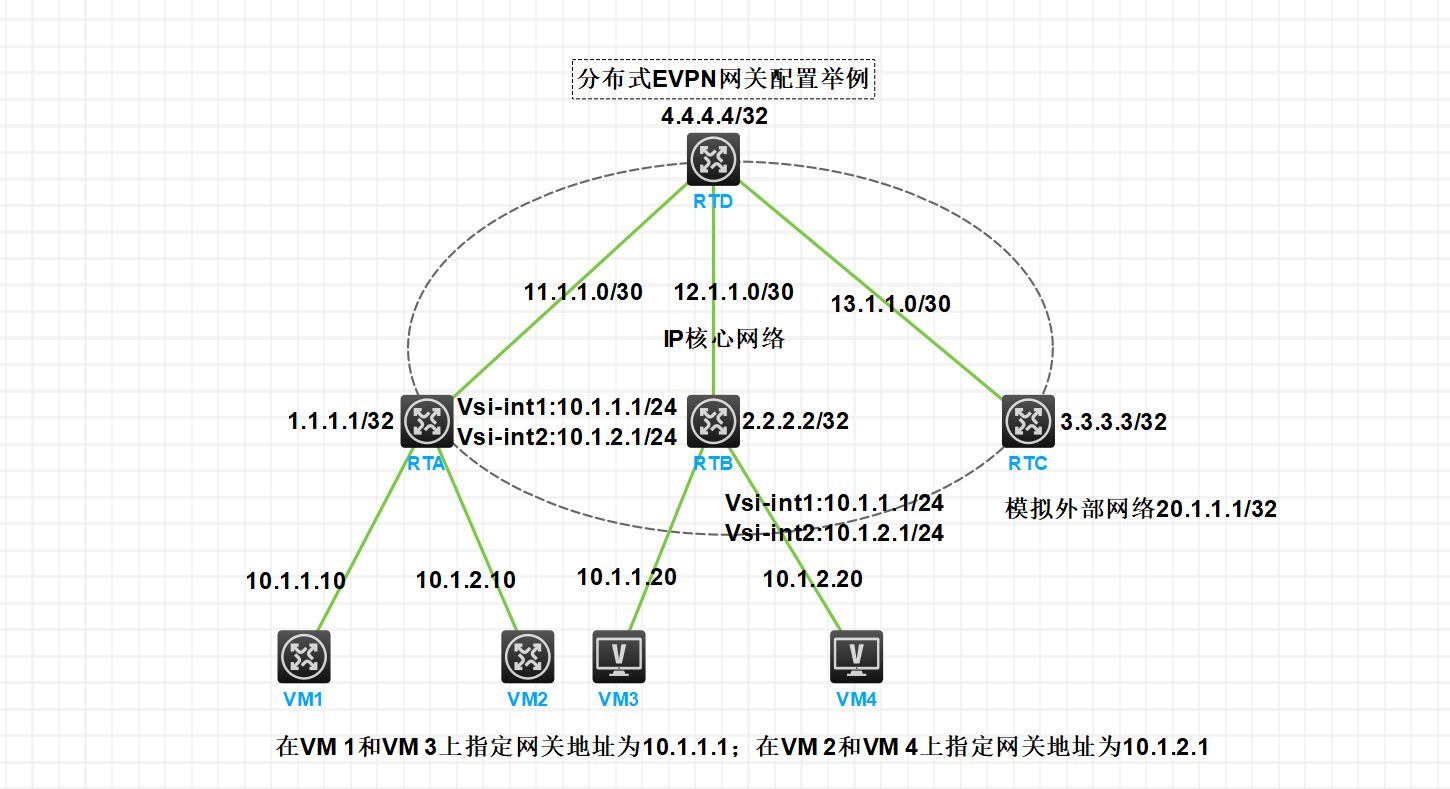

二、AI 超算网络长什么样?

一个典型的 AI 超算网络,通常分为:

1. 计算网络(GPU 互联网络)

这是 GPU 之间直接通信的网络,追求 极低延迟 + 超高带宽。

常见技术:

- InfiniBand(IB):目前 AI 训练最主流的选择,NVIDIA 主导,延迟极低

- RoCE(RDMA over Converged Ethernet):基于以太网实现 RDMA,国内超大规模集群广泛采用

- NVLink / NVSwitch:NVIDIA 自家 GPU 之间的高速互联,带宽可达数 TB/s

深度解析|以太网 vs InfiniBand 的区别

2. 存储 & 管理网络

训练数据、模型 checkpoint 的读写走存储网络;带外管理、健康监控走管理网络。这部分和传统数据中心网络更接近,但带宽要求也在快速拉升。

三、和传统网络有什么不同?

| 对比维度 | 传统数据中心网络 | AI 超算网络 |

|---|---|---|

| 流量模型 | Client-Server,南北向为主 | All-to-All,东西向为主 |

| 带宽要求 | 10G / 25G / 100G | 400G / 800G 起步 |

| 延迟要求 | 毫秒级可接受 | 微秒级,极度敏感 |

| 丢包容忍 | 有 TCP 重传兜底 | RDMA 场景几乎零容忍 |

| 核心协议 | TCP/IP | RoCEv2 / InfiniBand |

| 典型设备 | 传统交换机 | 支持 RoCE/IB 的专用交换机 |

四、网络工程师为什么要关注这个方向?

过去十年,网络工程师的核心战场是:企业园区网、运营商承载网、传统 IDC。

而现在,随着国内智算中心建设的爆发,一批新的岗位需求正在快速涌现:

- AI 网络架构设计

- RoCE / InfiniBand 网络部署调优

- 大规模 GPU 集群网络运维

- AIDC 网络方案售前 / 售后

这些岗位, 既需要扎实的网络基础, 又需要理解 AI 训练的通信模型 ——正好是新网工同学的机会窗口。

直播,韩老师会讲什么?

这是 AI超算网络系列直播的第一讲

专门为传统网络工程师和运维同学量身设计。

把“什么是AI超算网络”讲清楚:

- ✅ 为什么 AI 训练对网络有这么极端的要求?

- ✅ 熟悉了解 AI 超算网络的整体全貌

后续系列再逐期深挖:IB vs RoCE 怎么选、AIDC 拓扑怎么设计、传统网工怎么切入这个赛道……

零基础也能听懂,希望对你的职业未来发展有更新的认识